Palo Alto, California – Tuần trước, Inception Labs công bố Mercury, mô hình Diffusion Language Model (dLLM) đầu tiên trên thị trường, mở ra một kỷ nguyên mới về tốc độ và hiệu quả cho các ứng dụng AI thương mại.

Trong nhiều năm qua, mô hình ngôn ngữ lớn (LLM) như GPT-4 của OpenAI hay Claude của Anthropic hoạt động theo cơ chế tự hồi quy (autoregressive) – tạo từng từ một dựa trên văn bản trước đó. Cách tiếp cận này giúp AI tạo ra nội dung có độ chính xác cao, nhưng đi kèm với độ trễ lớn và chi phí tính toán cao.

Inception Labs cho rằng một bước đột phá về kiến trúc mô hình là điều cần thiết để AI trở nên nhanh hơn, rẻ hơn và hiệu quả hơn. Đó chính là lý do công ty đã phát triển Mercury, mô hình Diffusion Language Model đầu tiên, sử dụng kỹ thuật khuếch tán (diffusion) vốn đã thành công trong việc tạo ảnh (Midjourney, Stable Diffusion), video (Sora), và âm thanh (Riffusion).

Diffusion Language Model Là Gì?

Khác với cách tiếp cận tự hồi quy của các LLM truyền thống, mô hình Diffusion Language Model hoạt động theo nguyên lý “tinh chỉnh dần từ bản nháp thô đến nội dung hoàn chỉnh”.

🔹 Cách thức vận hành: Ban đầu, Mercury tạo ra một văn bản sơ bộ từ dữ liệu nhiễu. Sau đó, mô hình tinh chỉnh dần qua nhiều bước, tối ưu hóa chất lượng câu chữ và loại bỏ sai sót.

🔹 Điểm mạnh chính: DLLM có thể xử lý nhiều phần của văn bản cùng một lúc, thay vì phải tạo tuần tự từng từ một như LLM truyền thống. Điều này giúp tăng tốc độ xử lý đáng kể.

Nhanh Hơn Gấp 10 Lần, Giảm Chi Phí Đáng Kể

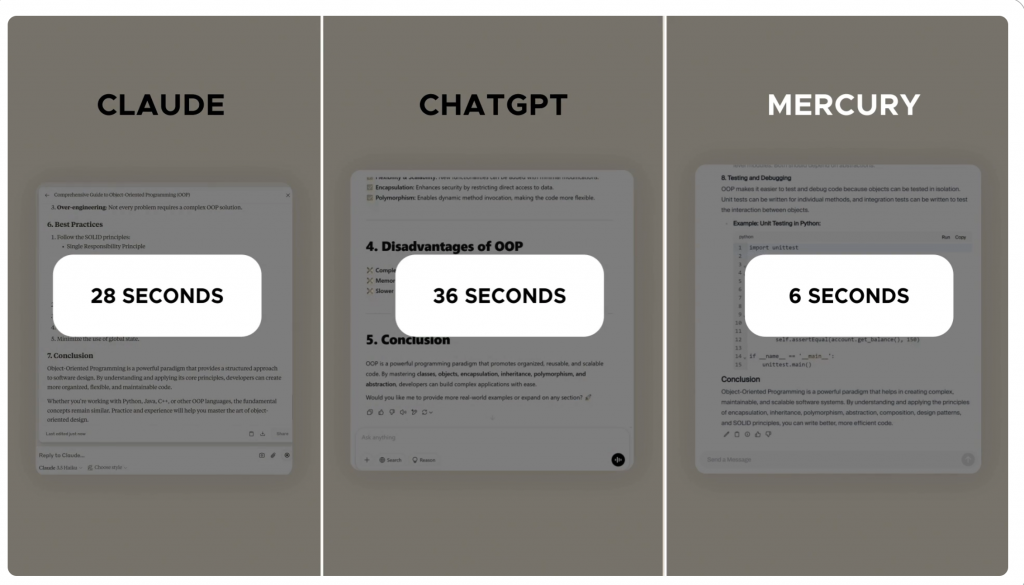

Theo Inception Labs, Mercury nhanh hơn từ 5 đến 10 lần so với các LLM tối ưu hóa tốc độ như GPT-4o Mini hay Claude 3.5 Haiku. Trong các thử nghiệm nội bộ, Mercury có thể xử lý hơn 1.000 tokens mỗi giây trên GPU NVIDIA H100 – một con số chỉ từng thấy trên các phần cứng chuyên dụng như Groq hay Cerebras.

Với tốc độ này, dLLM giúp giảm đáng kể chi phí hạ tầng AI khi doanh nghiệp triển khai chatbot, công cụ hỗ trợ khách hàng, hoặc hệ thống phân tích ngôn ngữ tự nhiên. “Chúng tôi đang làm cho AI không chỉ nhanh hơn, mà còn rẻ hơn để vận hành, giúp doanh nghiệp khai thác AI hiệu quả hơn,” đại diện Inception Labs cho biết.

Ứng Dụng Doanh Nghiệp – Tương Lai AI Thương Mại

Với công nghệ này, doanh nghiệp có thể đạt được các lợi ích vượt trội hơn đối với ứng dụng Trí tuệ nhân tạo tạo sinh:

- Chăm sóc khách hàng tự động: Giảm thời gian phản hồi, cải thiện chất lượng hội thoại với chatbot AI.

- Tạo nội dung doanh nghiệp: Viết email, báo cáo, và tài liệu nội bộ với tốc độ nhanh và độ chính xác cao.

- Lập trình AI: Mô hình Mercury Coder đạt điểm cao trong các bài kiểm tra lập trình, cạnh tranh với các AI lập trình tiên tiến như GitHub Copilot hay Claude.

- Ứng dụng AI tại thiết bị biên (Edge AI): Hiệu suất cao giúp triển khai AI ngay trên điện thoại, laptop mà không cần hạ tầng điện toán đám mây mạnh mẽ.

Cuộc Đua AI Bước Vào Giai Đoạn Mới

Sự ra mắt của Mercury đánh dấu một bước ngoặt quan trọng trong ngành công nghệ AI. Khi mà các công ty lớn như OpenAI, Google và Anthropic đang chạy đua trong việc cải thiện hiệu suất mô hình AI, Inception Labs lại chọn một hướng tiếp cận hoàn toàn khác – thay đổi nền tảng cách AI tạo ra văn bản.

Các chuyên gia dự đoán, Diffusion Language Model có thể trở thành tiêu chuẩn mới trong lĩnh vực xử lý ngôn ngữ tự nhiên, đặc biệt nếu nó tiếp tục chứng minh được khả năng thay thế các LLM truyền thống với tốc độ nhanh hơn và chi phí thấp hơn.

Hiện tại, Inception Labs đang cung cấp Mercury thông qua API và triển khai on-premise cho khách hàng doanh nghiệp. Trong tương lai, công ty dự kiến ra mắt phiên bản Mercury chuyên biệt cho chatbot và ứng dụng doanh nghiệp.

Liệu Diffusion Language Model có thay đổi hoàn toàn cách doanh nghiệp ứng dụng AI? Các công ty cần theo dõi sát sao cuộc cách mạng này.